自从在AI加速卡领域赚得盆满钵满,nVidia已经不满足于单纯在GPU领域发力,而是将未来的发展重点放在了高性能计算芯片方面,将CPU与GPU整合。就在近期nVidia官宣了GH200 Grace Hopper超级芯片已经全面投产,将专注于AI计算领域。

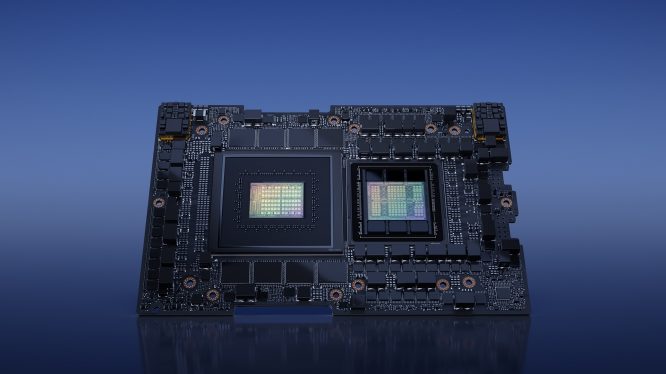

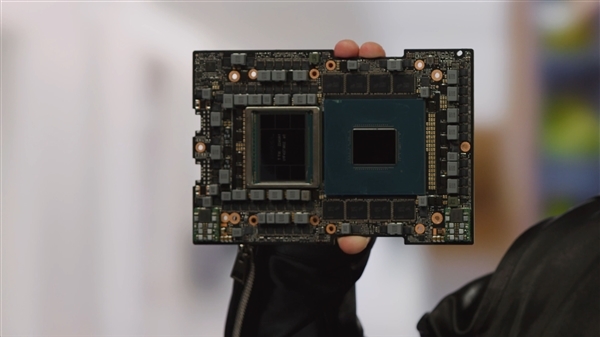

超级芯片的提出源自于2022年3月,nVidia发布了首款数据中心GPU Grace和高性能GPU Hopper,当时nVidia制造了两个版本,一个是Grace CPU二合一,一个是CPU+GPU的组合方案。如今量产的版本为CPU+GPU的组合。

在黄仁勋公布的相关细节中,Grace Hopper的CPU与GPU之间使用的事NVlink-C2C技术,总带宽达到了900GB/S,是PCIe5.0通道数的7倍,不仅功耗降低,还可满足生成式AI的需求。

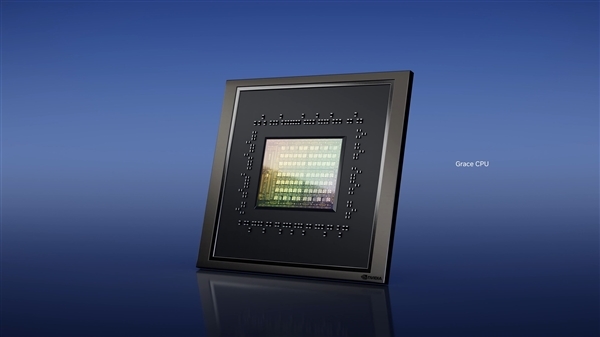

Grace CPU拥有72个Armv9 CPU核心,缓存容量198MB,支持LPDDR5X ECC内存,带宽高达1TB/s,还支持PCIe 5.0。

Hopper GPU则采用台积电4nm定制工艺,集成多达800亿个晶体管,号称世界上最先进的芯片,集成18432个CUDA核心、576个Tenor核心、60MB二级缓存,支持6144-bit HBM3/2e高带宽内存。

同时,nVidia宣布新的大型AI超级计算机“DGX GH200”,它配备了多达256颗GH200 Grace Hopper超级芯片,彼此NVLink Switch System互相连接,带宽提升48倍以上,对外可作为单个GPU使用,浮点性能高达1PFlops(每秒1千万亿次浮点计算)。

这款机型将主要用于开发面向生成式AI语言应用、推荐系统和数据分析工作的下一代大模型,或许这将推动大模型的进一步进化迭代。